뇌졸중 등으로 언어능력을 잃은 사람들이 생각하는 머릿속 신호를 말로 재구성하는 획기적인 기술이 개발돼 화제다. 뇌 속의 신호체계를 전극으로 감지하고, 컴퓨터로 소리를 표현해내는 기술이다. 뇌파를 통해 머릿속 목소리를 들을 수 있는 길이 열리게 된 것이다.

우리의 뇌에서는 매 순간 뇌파가 흘러나오고 있다. 뇌파란 뇌신경 사이에 신호가 전달될 때 생기는 약한 전기의 흐름을 말한다. ‘뇌에서 나오는 신호’ 혹은 ‘뇌의 목소리’라고 할 수 있다. 뇌의 활동 상황을 측정하는 가장 중요한 지표로, 심신의 상태에 따라 다르게 나타난다.

우리가 어떤 말을 하려고 하면 성대 등에 이어진 신경에 신호를 보내기 전에 그 말에 해당하는 특정한 패턴의 뇌파가 생성된다. 그 뇌파를 분석하면 그 사람이 어떤 말을 하려고 하는지 알 수 있다. 과학자들은 이를 이용해 말을 못 하는 사람들이 생각만으로 메시지를 타인에게 전달할 수 있도록 만드는 연구에 몰입 중이다.

지난 1월 3일 과학저널 ‘사이언스’는 과학자들이 뇌에서 나오는 신호를 포착해 언어로 전환하는 데 성공했다고 밝혔다. 환자의 뇌에 자신의 의사를 전달해줄 전극을 부착한 후 전극에 연결된 신경망(neural network) 컴퓨터 모델을 이용하여 그 사람이 생각하는 단어와 문자를 말로 바꾸었는데, 그중 일부는 다른 사람들이 듣고 이해하기에 충분했다는 것이다.

물론 ‘환자들이 상상하는 언어’를 완벽하게 재창조한 수준은 아니다. 하지만 컴퓨터로 재구성된 언어를 다른 사람에게 전달하는 데 일부 성공했다는 것만도 대단한 성과라는 게 이번 연구를 주도한 연구자들의 설명이다. 스위스 제네바대학의 뇌과학자 스테파니 마틴(Stephanie Martin) 교수, 컬럼비아대학의 컴퓨터과학자 니마 메스가라니(Nima Mesgarani) 교수 등이 그 주인공들이다.

마비로 인해 말을 할 수 없는 환자들일지라도 뇌 속에는 ‘말하고자 하는 내용’에 대한 신호(signal)가 들어 있다. 하지만 그런 신호를 직접 해독하는 방법은 지금껏 개발되지 않았다. 하지만 마틴 교수팀은 사람들이 큰소리로 책을 읽을 때, 소리 없이 입만 뻥긋 했을 때, 녹음된 소리를 들을 때 등 다양한 영역에서 뇌의 변화를 모니터링하여 이를 해독하는 데 성공했다.

교수팀은 컴퓨터 모델을 이용해 여러 주파수의 각기 다른 소리들이 나오고 있을 때 어떤 부위가 어떤 속도로 뇌파를 발산하는지 지도를 작성했다. 이 모델의 도움을 받아 환자에게 생각할 단어들을 제시하고 환자가 이 중 어떤 단어를 선택했는지 알아맞힐 수 있었다. 생각하면서 뇌파를 조절하는 훈련을 받은 환자는 컴퓨터 화면의 글자를 조합해 ‘목이 마르다’ 또는 ‘당신과 이야기해 좋다’와 같은 의사 표현을 할 수 있었다. 이러한 연구 과정 끝에 마침내 영상으로 나타난 뇌파를 컴퓨터 모델을 통해 소리로 전환, 일부 단어들을 재구성하는 데까지 성공을 거뒀다. 부분적이나마 환자의 생각을 실제 말을 하고 있는 것처럼 억양과 톤(tone)으로 재구성하게 된 것이다.

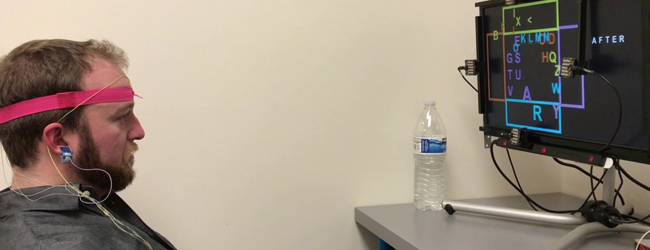

지금까지 언어능력을 상실한 사람들은 눈이나 그 밖의 작은 몸짓을 이용하여 컴퓨터 커서(cursor)를 제어하거나 컴퓨터 화면상의 글자들을 선택해 자신의 의사를 표현하는 수준이었다. 마치 환자가 손에 마우스를 쥐고 컴퓨터를 조작하는 것처럼 보이기 때문에 이 기술을 ‘정신 마우스’라고도 한다. 이를 활용한 대표적 인물이 우주과학자 스티븐 호킹이다. 그는 병이 진행되면서 손가락도 움직일 수 없게 되자 얼굴(뺨) 근육의 움직임으로 안경에 장착된 스위치를 작동시켜 단어를 조합하는 방식으로 연구와 의사소통을 해왔다. 하지만 복잡한 대화를 이어가기는 어려웠다.

뇌-컴퓨터 인터페이스

이렇게 생각만으로 뇌파를 센서로 전달해 컴퓨터나 기계를 움직이는 기술을 ‘뇌-컴퓨터 인터페이스(BCI·brain-computer interface)’라고 말한다. 최근 과학자들은 BCI를 활용해 언어를 잃은 환자의 생각을 직접 말로 표현할 수 있는 기술을 개발하고 있다. 케임브리지대학에서는 눈으로 모니터를 움직여 환자의 의사를 표현하는 ‘홍채·컴퓨터 인터페이스’를 개발 중이다. BCI가 뇌 환자의 언어를 완전하게 재구성할 수 있다면 환자의 의사소통은 자유로워질 것이다.

그러나 뇌의 신호와 언어를 직접 연관시키는 것은 만만치 않은 일이다. 여러 가지 신호들이 언어음으로 번역되는 과정은 사람마다 다르기 때문이다. 뇌파를 분석하는 컴퓨터 모델이 완전하게 성공하려면 극도로 정확한 데이터가 필요한데, 그러려면 뇌 속에 전극을 심어 기록하는 수밖에 없다. 하지만 전극을 심는 일은 아무 때나 할 수 있는 게 아니다. 뇌종양을 제거할 때와 같이 극히 드문 경우에만 가능하다.

컬럼비아대학의 메스가라니 교수팀은 이를 해결할 방법으로 다양한 상황에서 발생하는 뇌의 언어적 신호를 소리로 바꾸는 실험을 진행하고 있다. 각기 다른 개인의 다양한 신호체계를 해독하여 그 내용들은 일일이 도표화하는 연구를 하고 있는 것이다.

특히 교수팀은 5명의 뇌전증 환자로부터 입수한 데이터를 활용 중이다. 그들의 청각피질(말할 때와 들을 때 모두 활성화되는 영역)에서 나온 전기 정보를 0부터 9까지의 신호로 바꾸고, 이들 데이터를 컴퓨터에 입력해 말로 재구성하고 있는 중이다. 컴퓨터가 생성한 소리(언어)를 다른 사람들에게 들려준 결과 이 중 70%는 정확하게 알아듣는 것으로 나타났다. 교수팀의 마지막 목표는 뇌파를 100% 정교하게 표현할 수 있는 컴퓨터의 음성 모델을 만들어 언어 표현이 마비된 환자와의 완전 소통을 가능하게 하는 것이다.

독일 브레멘대학의 미구엘 앙그리크 교수와 네덜란드 마스트리흐트대학의 크리스티안 헤르프 교수가 이끄는 연구팀 또한 뇌파를 소리로 바꾸는 연구를 하고 있다. 이들은 뇌종양 수술을 받은 환자 6명을 대상으로 마이크를 이용해 한 음절의 단어를 크게 읽을 때 음성을 녹음하고, 동시에 전극을 이용해 뇌에서 나오는 신호를 기록했다. 그 결과 환자들의 의사를 마이크로폰으로 재구성하는 데 성공했다. 생성 단어의 40% 정도를 알아들을 수 있는 수준이다.

이처럼 생각을 소리로 옮기는 장치(뇌파 컴퓨터)가 현실화된다면 세상과 단절된 채 살아가는 언어 장애자들의 의사소통에 획기적인 보조나 대안 역할을 하게 될 것이다. 말 못 하는 사람들이 머릿속에 떠올리는 표현을 마음껏 펼칠 날이 언제쯤 다가올까.